NVIDIA está llevando una serie de avances en renderización, simulación e inteligencia artificial generativa a SIGGRAPH 2024, la principal conferencia de gráficos por computadora, que tendrá lugar en Denver.

Más de 20 documentos de NVIDIA Research presentan innovaciones que avanzan en generadores de datos sintéticos y herramientas de renderización inversa que pueden ayudar a entrenar modelos de próxima generación. La investigación de IA de NVIDIA está mejorando la simulación al aumentar la calidad de la imagen y desbloquear nuevas formas de crear representaciones 3D de mundos reales o imaginarios.

Los documentos se centran en modelos de difusión para IA generativa visual, simulación basada en física y renderización impulsada por IA cada vez más realista. Incluyen dos ganadores del premio Best Paper Award y colaboraciones con universidades de EE.UU., Canadá, China, Israel y Japón, así como investigadores de empresas como Adobe y Roblox.

Estas iniciativas ayudarán a crear herramientas que los desarrolladores y las empresas pueden usar para generar objetos virtuales, personajes y entornos complejos. La generación de datos sintéticos puede luego ser aprovechada para contar historias visuales impactantes, ayudar a los científicos a comprender fenómenos naturales o asistir en la capacitación basada en simulaciones para robots y vehículos autónomos.

modelos de difusión mejoran la pintura de texturas y la generación de texto a imagen

Los modelos de difusión, una herramienta popular para transformar indicaciones de texto en imágenes, pueden ayudar a artistas, diseñadores y otros creadores a generar rápidamente visuales para guiones gráficos o producción, reduciendo el tiempo necesario para dar vida a sus ideas.

Dos documentos de autores de NVIDIA están mejorando las capacidades de estos modelos de IA generativa.

ConsiStory, una colaboración entre investigadores de NVIDIA y la Universidad de Tel Aviv, facilita la generación de múltiples imágenes con un personaje principal consistente, una capacidad esencial para casos de uso de narración como la ilustración de una tira cómica o el desarrollo de un guion gráfico. El enfoque de los investigadores introduce una técnica llamada atención compartida basada en el sujeto, que reduce el tiempo necesario para generar imágenes consistentes de 13 minutos a alrededor de 30 segundos.

El año pasado, investigadores de NVIDIA ganaron el premio Best in Show en el evento Real-Time Live de SIGGRAPH por modelos de IA que convierten indicaciones de texto o imagen en materiales texturizados personalizados. Este año, presentan un documento que aplica modelos de difusión generativa 2D a la pintura de texturas interactivas en mallas 3D, permitiendo a los artistas pintar en tiempo real con texturas complejas basadas en cualquier imagen de referencia.

impulso al desarrollo en simulación basada en física

Los investigadores gráficos están reduciendo la brecha entre los objetos físicos y sus representaciones virtuales con simulación basada en física, una gama de técnicas para hacer que los objetos digitales y los personajes se muevan de la misma manera que lo harían en el mundo real.

Varios documentos de NVIDIA Research presentan avances en el campo, incluyendo SuperPADL, un proyecto que aborda el desafío de simular movimientos humanos complejos basados en indicaciones de texto.

Utilizando una combinación de aprendizaje por refuerzo y aprendizaje supervisado, los investigadores demostraron cómo el marco SuperPADL puede entrenarse para reproducir el movimiento de más de 5,000 habilidades, y puede ejecutarse en tiempo real en una GPU NVIDIA de consumo.

Otro documento de NVIDIA presenta un método de física neural que aplica IA para aprender cómo se comportarían los objetos —ya sea representados como una malla 3D, un NeRF o un objeto sólido generado por un modelo de texto a 3D— al ser movidos en un entorno.

Un documento escrito en colaboración con investigadores de Carnegie Mellon University desarrolla un nuevo tipo de renderizador que, en lugar de modelar la luz física, puede realizar análisis térmicos, electrostática y mecánica de fluidos. Nombrado uno de los cinco mejores documentos en SIGGRAPH, el método es fácil de paralelizar y no requiere una limpieza engorrosa del modelo, ofreciendo nuevas oportunidades para acelerar los ciclos de diseño de ingeniería.

En el ejemplo anterior, el renderizador realiza un análisis térmico del rover Mars Curiosity, donde mantener las temperaturas dentro de un rango específico es crítico para el éxito de la misión.

Documentos adicionales de simulación presentan una técnica más eficiente para modelar mechones de cabello y una técnica para acelerar la simulación de fluidos por 10x.

subiendo el estándar para el realismo en renderización y simulación de difracción

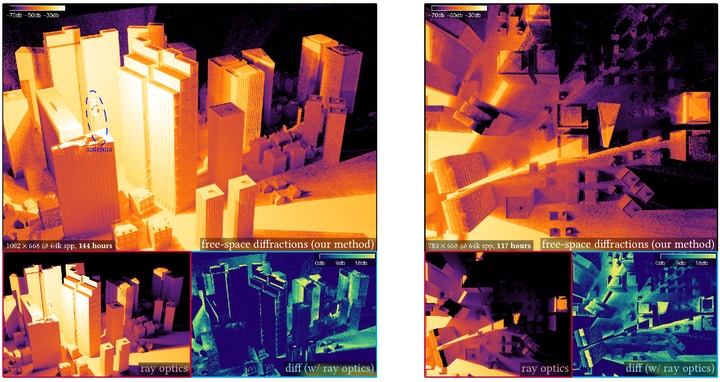

Otro conjunto de documentos de NVIDIA presenta nuevas técnicas para modelar la luz visible hasta 25x más rápido y simular efectos de difracción, como los utilizados en la simulación de radar para el entrenamiento de autos autónomos, hasta 1,000x más rápido.

Un documento de NVIDIA y la Universidad de Waterloo aborda la difracción en espacio libre, un fenómeno óptico donde la luz se dispersa o se curva alrededor de los bordes de los objetos. El método del equipo puede integrarse con flujos de trabajo de trazado de caminos para aumentar la eficiencia de la simulación de difracción en escenas complejas, ofreciendo hasta 1,000x de aceleración. Más allá de la renderización de luz visible, el modelo también podría usarse para simular las longitudes de onda más largas del radar, el sonido o las ondas de radio.

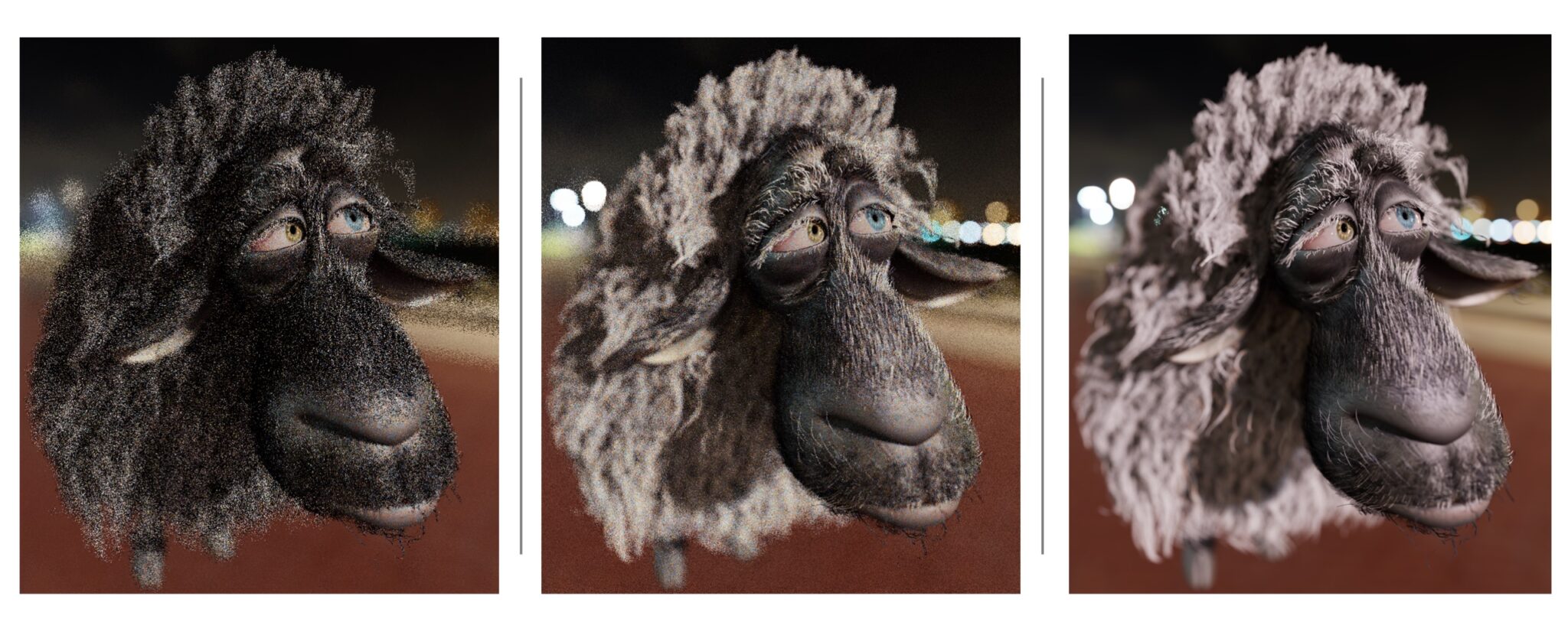

El trazado de caminos toma numerosas muestras de caminos —rayos de luz de múltiples rebotes que viajan a través de una escena— para crear una imagen fotorrealista. Dos documentos de SIGGRAPH mejoran la calidad de las muestras para ReSTIR, un algoritmo de trazado de caminos introducido por primera vez por investigadores de NVIDIA y Dartmouth College en SIGGRAPH 2020 que ha sido clave para llevar el trazado de caminos a juegos y otros productos de renderización en tiempo real.

Uno de estos documentos, una colaboración con la Universidad de Utah, comparte una nueva forma de reutilizar caminos calculados que aumenta el recuento efectivo de muestras hasta 25x, mejorando significativamente la calidad de la imagen. El otro mejora la calidad de las muestras al mutar aleatoriamente un subconjunto del camino de la luz. Esto ayuda a que los algoritmos de denoising funcionen mejor, produciendo menos artefactos visuales en la renderización final.

enseñando a la IA a pensar en 3D

Los investigadores de NVIDIA también están presentando en SIGGRAPH herramientas de IA multipropósito para representaciones y diseño en 3D.

Un documento introduce fVDB, un marco optimizado para GPU para el aprendizaje profundo en 3D que se ajusta a la escala del mundo real. El marco fVDB proporciona infraestructura de IA para la gran escala espacial y alta resolución de modelos 3D a escala urbana y NeRFs, además de la segmentación y reconstrucción de nubes de puntos a gran escala.

Un documento ganador del premio Best Technical Paper, escrito en colaboración con investigadores del Dartmouth College, introduce una teoría para representar cómo los objetos 3D interactúan con la luz. La teoría unifica un espectro diverso de apariencias en un único modelo.

Y una colaboración con la Universidad de Tokio, la Universidad de Toronto y Adobe Research introduce un algoritmo que genera curvas suaves y que llenan el espacio en mallas 3D en tiempo real. Mientras que los métodos anteriores tomaban horas, este marco se ejecuta en segundos y ofrece a los usuarios un alto grado de control sobre el resultado para permitir un diseño interactivo.

NVIDIA en SIGGRAPH

Aprende más sobre NVIDIA en SIGGRAPH, con eventos especiales que incluyen una charla junto al fuego entre el fundador y CEO de NVIDIA, Jensen Huang, y Lauren Goode, escritora senior en WIRED, sobre el impacto de la robótica y la IA en la digitalización industrial.

Los investigadores de NVIDIA también presentarán OpenUSD Day por NVIDIA, un evento de día completo que muestra cómo los desarrolladores y líderes de la industria están adoptando y evolucionando OpenUSD para construir pipelines 3D habilitados por IA.

NVIDIA Research cuenta con cientos de científicos e ingenieros en todo el mundo, con equipos enfocados en temas como IA, gráficos por computadora, visión por computadora, autos autónomos y robótica.